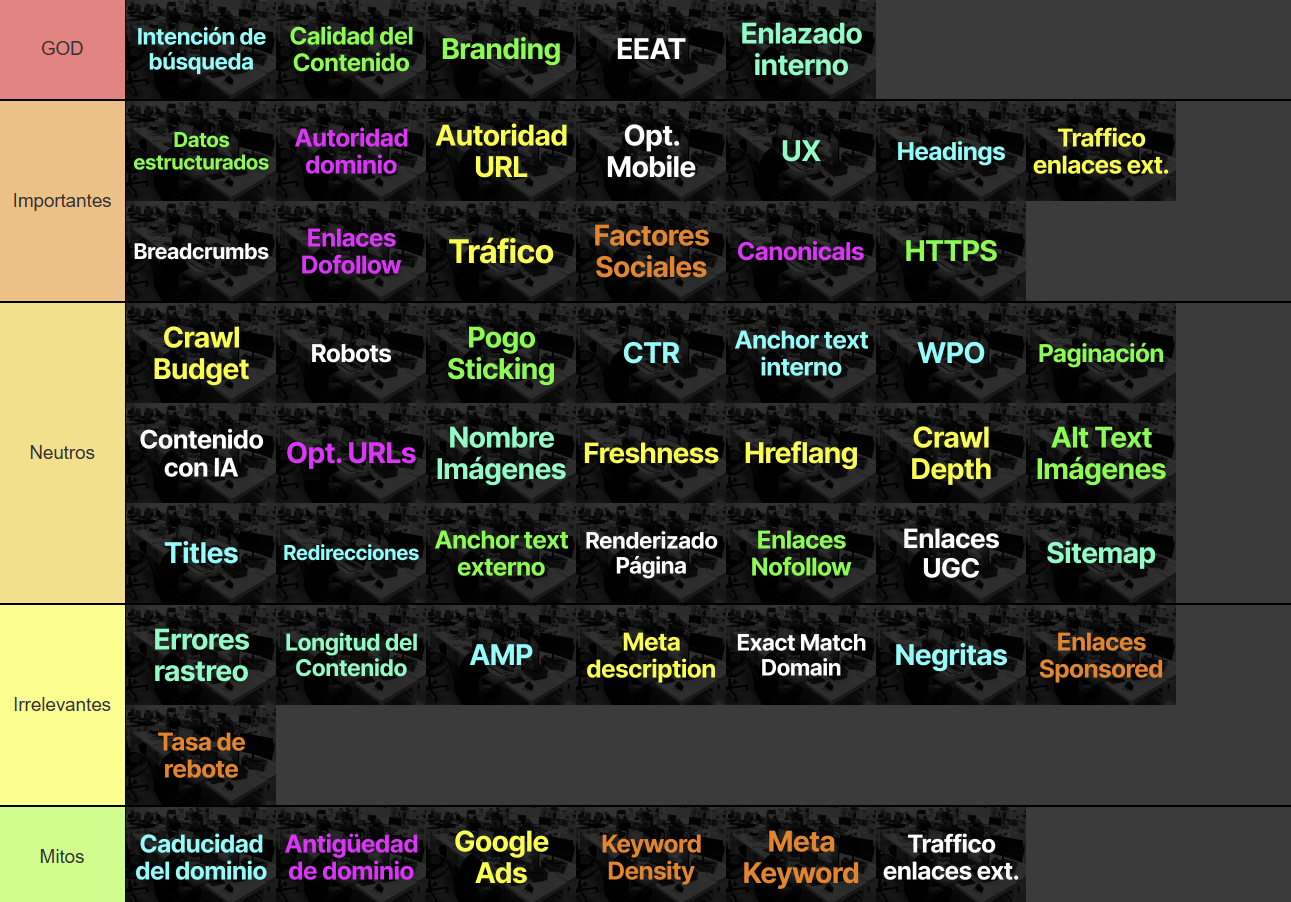

La Tier List definitiva de factores SEO en 2025

Vamos a imaginar que tienes un tablero lleno de piezas, y que cada pieza es un factor SEO. Pues llevo casi 20 años moviendo esas piezas y aprendiendo qué jugadas ganan partidas en Google. En 2025, el posicionamiento web sigue siendo crucial para destacar en Internet, pero con algoritmos cada vez más inteligentes es vital saber priorizar. No se trata de llenar un checklist sin sentido, sino de enfocar esfuerzos en lo que de verdad tendrá impacto.

Por eso, organizar los factores en una tier list (lista por niveles de importancia) resulta tan útil: nos permite acercarnos, de un vistazo, a qué aspectos son imprescindibles (GOD tier), cuáles son importantes, cuáles son neutros o irrelevantes, y qué cosas no son más que mitos del SEO. Pero no quiero que esto se convierta en el clásico artículo de SEO técnico (aunque hablaré de temas técnicos). Prefiero enfocarlo como si fuéramos dos amigos tomando un café y comentando trucos SEO.

Venga, ve a por tu bebida favorita y prepárate (se viene post laaaargo), porque voy a compartir contigo mi propio criterio y experiencia, para que sepas en qué centrarte (y qué ignorar) al optimizar tu sitio web en 2025.

Factores “GOD” (Imprescindibles)

Los factores GOD tier son los esenciales, los que no pueden faltar. Si tu web falla gravemente en alguno de estos, puedo asegurarte que estás jugando el partido con clara desventaja. Aquí incluyo aquellos aspectos que, en mi experiencia, pueden acabar decidiendo quién aparece y quién no en los primeros resultados de Google. Veamos cada uno:

Intención de búsqueda

Si tu contenido no responde a la intención del usuario, olvídate de buenas posiciones. Google se ha vuelto extremadamente hábil interpretando qué busca realmente la gente más allá de las palabras clave que teclean. Por ejemplo, si alguien busca “mejor smartphone 2025”, Google sabe que probablemente quiere comparativas y opiniones, no la página genérica de una marca.

He visto sitios con buen SEO técnico fracasar porque su contenido no encajaba con la intención de búsqueda del usuario. En cambio, aquellos que ajustan su contenido exactamente a lo que las personas necesitan (información, compra, navegación, etc.) triunfan. La lección tras años optimizando: ponte en los zapatos del usuario. Antes de crear cualquier página, pregúntate “¿qué espera encontrar realmente quien busca este término?” y ofrece eso de la mejor manera posible.

Calidad del contenido

Seguro has oído mil veces “el contenido es el rey”. Déjame matizar: el contenido de calidad es el rey. En 2025 ya no vale publicar por publicar ni crear artículos de relleno. Google evalúa cada vez mejor si un texto aporta valor real. Piensa en las veces que entraste a una web y saliste enseguida porque era puro fluff (paja) sin información útil… Google detecta esas señales. En cambio, un contenido bien trabajado, que profundiza cuando toca, que es claro y está bien estructurado, engancha al usuario y por ende a Google. En resumen: calidad antes que cantidad. Publica menos, pero mejor.

Branding (autoridad de marca)

Este factor ha cobrado un protagonismo enorme. Google premia a los sitios que inspiran confianza y eso, en gran medida, viene dado por el reconocimiento de marca. Te hablo de marca no sólo como logo, sino como presencia en tu sector. Si tu web es la que todos citan o buscan, Google lo nota. ¿No te ha pasado que sueles ver sitios conocidos (Amazon, Wikipedia, marcas líderes) dominando resultados?

No es casualidad; una marca fuerte acumula menciones, backlinks naturales y búsquedas directas de usuarios, y todo eso envía a Google un mensaje de “esta página es relevante y confiable”. Así que si aún no has pensado en branding, hazlo: trabaja por ser reconocido en tu nicho. Aunque suene menos “técnico”, en 2025 SEO y marca van de la mano.

E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness)

Estas siglas significan Experiencia, Experiencia del autor (sí, otra vez “experience” pero Google lo desglosa en la del contenido y la del autor), Autoridad y Confianza. Nacen de las directrices de calidad de Google y cada año pesan más. ¿Y esto en qué se traduce? En que Google prefiere contenido creado por gente experta, con experiencia demostrable en el tema, publicado en sitios de autoridad y que transmitan confianza. Pongamos un caso práctico: un foro cualquiera donde un usuario da consejos médicos vs. un artículo escrito por un médico titulado en la web de una clínica reconocida. ¿Cuál crees que Google posicionará mejor para la búsqueda “síntomas de diabetes” por ejemplo? Claramente el segundo, por E-E-A-T. En sectores “delicados” como salud, finanzas o legal (los llamados Your Money or Your Life), E-E-A-T es absolutamente determinante.

Recuerdo en 2018 el llamado “Medical Update” de Google que hizo caer muchas webs de salud que no tenían suficiente autoridad o credibilidad. En 2025 esto se ha refinado más: si tu sitio trata temas sensibles y no demuestras credenciales (autores expertos, fuentes confiables, políticas claras), lo tendrás difícil. Mi consejo: presume de experiencia y autoridad. Muestra quién está detrás del contenido (biografía del autor, experiencia), consigue enlaces o menciones de sitios reconocidos de tu sector, y cuida factores de confianza como tener página de contacto, aviso legal, opiniones de clientes, etc. Toda esa suma de señales ayuda a que Google diga “esta página es seria y confiable, merece un buen puesto”.

Enlazado interno

Mucho se habla de los enlaces externos (backlinks), pero el linking interno de tu propia web es igual de crucial. Piensa en tu sitio como una ciudad y los enlaces internos como sus carreteras: si las carreteras están bien trazadas, Google (y los usuarios) navegan y encuentran todo fácilmente; si no, habrá callejones sin salida. Un buen enlazado interno reparte la “autoridad” por tus páginas y le deja claro a Google cuáles son las más importantes.

Te cuento un ejemplo con un cliente reciente: una tienda online con un blog lleno de artículos útiles, pero que estaba totalmente aislado de la tienda (no enlazaban productos en los posts ni viceversa). Resultado: el blog atraía visitas pero esas visitas no pasaban a la tienda, y Google tampoco relacionaba bien esas páginas con los productos. Reestructuré el enlazado interno: cada post de blog recomendaba productos con enlaces, y las fichas de producto enlazaban a guías o comparativas relevantes del blog. ¿Qué crees? Mejoró tanto la indexación (Google descubrió antes nuevo contenido) como el posicionamiento de ciertos productos, al quedar conectados con contenido de calidad.

Cada enlace interno es una pista para Google sobre qué considera relevante tu web. Aprovecha eso creando una arquitectura lógica, donde cada página valiosa esté a mano mediante enlaces contextuales o menús claros. Con los años he visto sitios aparentemente mediocres superar a sitios con más recursos, simplemente porque tenían un enlazado interno impecable que hacía brillar sus mejores contenidos.

Arquitectura transaccional

Este concepto suena técnico, pero no es más que la estructura del sitio orientada a conversiones (ventas, contactos, etc.) manteniendo contento al usuario. Piensa en una web bien diseñada donde desde un artículo informativo puedes saltar fácilmente a un servicio o producto relacionado. Esa es una arquitectura transaccional óptima: combina contenido informativo con el camino hacia la acción que quieres que el usuario realice. ¿Y cómo impacta esto en SEO? Por un lado, una buena arquitectura transaccional retiene a los usuarios más tiempo y les hace navegar más páginas (señales positivas de cara a Google).

Por otro, facilita el rastreo: Google seguirá esos “caminos internos” y entenderá la jerarquía de tu sitio, identificando qué partes son informativas y cuáles transaccionales. En SEO, esas mejoras de UX suelen venir acompañadas de mejor posicionamiento también, especialmente en e-commerce y sitios de servicios. En 2025, Google valora sitios con estructura lógica y orientada al usuario. Una web confusa, donde la información y la acción están desconectadas, no solo pierde ventas: también pierde puntos para posicionamiento frente a una web donde todo encaja y guía al usuario sin fricciones.

Como ves, estos factores “GOD” son de sentido común pero requieren trabajo y enfoque. Si clavas la intención de búsqueda, ofreces contenido excepcional, construyes tu marca, demuestras autoridad, enlazas inteligentemente tu contenido y ofreces una arquitectura amigable, estarás en la liga de los ganadores del SEO.

Factores Importantes

Pasemos al siguiente nivel de la tier list: los factores importantes. No son tan críticos como los anteriores por sí solos, pero marcan diferencias cuando la competencia también tiene cubierto lo básico. Digamos que son “el plus” que, bien afinado, puede darte una ventaja competitiva. Voy a desglosarlos uno a uno con brevedad, porque son bastantes, pero todos merecen atención:

Datos estructurados (schema)

Incluir datos estructurados en tu web (schema.org para recetas, productos, FAQ, reviews, etc.) no es que mágicamente te suba de posición, pero sí mejora cómo se muestra tu resultado en las SERP de Google. Un ejemplo claro son las valoraciones con estrellitas en resultados de productos o las preguntas frecuentes desplegables. Esto atrae más clics.

¿Por qué es importante? Porque aunque Google dice que el marcado schema no es un factor de ranking directo, indirectamente ayuda: un mejor snippet aumenta tu CTR en resultados, y un mayor CTR puede traerte más tráfico. He visto webs de recetas ganar mucha visibilidad al aparecer con foto, tiempo de cocción y calorías directamente en la SERP gracias al marcado de datos. Conclusión: vale la pena implementar schema para destacar y facilitarle a Google entender tu contenido.

Autoridad de dominio

Aquí hablamos del peso general que tiene tu dominio a ojos de Google. No confundir con una métrica tipo “Domain Authority” de Moz, sino el concepto general: un dominio con solera, con buen perfil de enlaces y reputación en su temática. ¿Importa la antigüedad? No por sí sola (un dominio viejo sin contenido de calidad no rankea porque sea viejo), pero un dominio que lleva años ganando buenos enlaces y satisfaciendo usuarios suele ser más confiable.

Por ejemplo, un periódico digital veterano tiende a posicionar sus nuevos artículos más fácil que un blog recién creado, porque Google ya confía en ese dominio. Esto significa que cuando trabajas el SEO, no sólo pienses página por página, sino en cómo reforzar la autoridad global de tu sitio: conseguir enlaces de calidad hacia varias secciones, construir un historial de buen contenido, etc. Es un trabajo constante, pero muy gratificante cuando ves que tu web en general “se gana” el favor de Google.

Autoridad de la página (URL específica)

Además del valor global del dominio, cada página puede acumular su propia autoridad. Esto viene dado sobre todo por enlaces que apuntan a ella (externos e internos). Si una página en concreto recibe muchos enlaces de calidad, Google la considerará importante. Un ejemplo clásico: la home de un sitio suele tener más autoridad (porque recibe la mayoría de enlaces externos, branding, etc.), por eso a veces posiciona por términos genéricos.

Pero si quieres posicionar una URL interna (digamos, una página de servicio o un post estrella), necesitas enlazarla bien internamente y, si es posible, atraerle algunos backlinks externos. Cuida qué páginas dentro de tu sitio son las que más “poder” reciben y distribuye la autoridad internamente según tus prioridades. La autoridad de dominio te da una base, pero la autoridad de URL bien trabajada es lo que impulsa páginas específicas.

Optimización móvil

Este factor ya no es opcional desde hace años. En 2025 es mobile-first o nada. Google indexa primero la versión móvil de tu sitio (lo que ve un smartphone), así que si tu web no es amigable en móviles, tienes un problema serio. ¿Qué implica optimizar para móvil? Diseño responsive (que se adapte a distintos tamaños de pantalla), contenido legible sin hacer zoom, botones y enlaces clicables con el dedo, y por supuesto velocidad de carga en móvil. Un caso: en 2022 una web de noticias implementó AMP (cuando aún se usaba) y luego su propio diseño PWA ultrarrápido en móvil; su tráfico orgánico móvil subió notablemente tras mejorar el rendimiento.

Aunque AMP ya no es necesario, la velocidad y usabilidad móvil siguen siendo fundamentales. Además, más del 60% del tráfico suele ser móvil en muchas industrias, así que por tu propio negocio también conviene. Para resumir: diseño mobile-friendly y tiempos de carga reducidos son factores importantes que Google vigila – no tenerlos al día es darte un tiro en el pie en SEO.

UX (experiencia de usuario)

La UX es un paraguas amplio que incluye rendimiento (Core Web Vitals, tiempos de carga, estabilidad visual), facilidad de navegación, diseño limpio, etc. Google ha llegado a incorporar métricas de experiencia (como Largest Contentful Paint, Cumulative Layout Shift, etc.) en sus algoritmos de ranking, aunque con un peso moderado. ¿Qué significa esto? Que una web que ofrece una experiencia fluida puede tener una ventaja sobre otra lenta o confusa, especialmente si el resto de factores están parejos.

Por ejemplo, en la actualización de Page Experience, sitios que cuidaron sus Core Web Vitals tuvieron un pequeño empujón. Pero tampoco hay que obsesionarse: si tu contenido es fantástico pero tu web tarda medio segundo más en cargar que la del competidor, no vas a ser penalizado. Ahora bien, si tu sitio es un desastre de pop-ups intrusivos, estructura caótica y tiempos eternos, Google lo notará (y los usuarios también, marchándose). Tu objetivo debe ser que la gente que llegue se quede porque le resulta agradable y fácil consumir tu contenido o comprar tu producto. Un buen UX reduce la posibilidad de pogo-sticking (usuarios que rebotan de vuelta a Google insatisfechos) y mejora conversiones.

Piensa en sitios con buena UX que conozcas (seguro recuerdas algún blog o tienda donde todo iba como la seda) e inspírate. La UX al final conecta con el fin último de Google: contentar al usuario. Así que aunque su impacto sea indirecto, es un factor importante a tener en cuenta.

Headings (encabezados bien estructurados)

Hablemos de la etiqueta H1, H2, etc. Un mito común era “¡solo un H1 por página y tiene que llevar la keyword exacta!”. Hoy día sabemos que no hay una fórmula mágica de encabezados, pero sí ayudan a estructurar el contenido para Google y para el lector. Un buen uso de headings (jerárquico, lógico) permite a Google entender de qué trata cada sección. ¿Es un factor de ranking potente? No directamente; arreglar la secuencia de H2/H3 no te va a subir diez puestos como por arte de magia.

De hecho, John Mueller de Google comentó que tener los headings en orden correcto ayuda ligeramente a entender el contenido, pero no es algo que cambie drásticamente las posiciones. Aun así, es importante porque forma parte de las buenas prácticas: mejora la accesibilidad y la claridad. Además, un buen título (H1) descriptivo y unos subtítulos (H2, H3…) bien planteados pueden incluso ganar featured snippets o fragmentos destacados.

He asesorado a sitios donde simplemente al reestructurar un artículo largo con encabezados claros para cada tema, no solo mejoramos SEO sino que los usuarios pasaron más tiempo en la página (porque escaneaban mejor la info). Así que mi consejo: usa encabezados para ordenar ideas, incluir términos relacionados, hacer preguntas que luego respondes… No por trucar el algoritmo, sino porque un contenido organizado rinde mejor en todos los sentidos. Y Google apreciará esa claridad.

Tráfico desde enlaces externos

Aquí me refiero al tráfico de referencia que llega a tu web a través de enlaces en otras webs (por ejemplo, un enlace en un foro, en un periódico digital, en Reddit, etc.). ¿Por qué lo pongo como factor SEO? Porque si bien el hecho de que te llegue tráfico no es un factor de ranking directo (Google no posiciona porque te visiten mucho, sino al revés), suele ser indicativo de algo positivo: tus contenidos están siendo compartidos o mencionados. Además, ese tráfico externo puede generar a su vez más señales: usuarios que pasan tiempo en tu sitio, que incluso luego hacen búsquedas de tu marca, o que comparten tu contenido en redes.

No persigas el tráfico por el tráfico, pero sí trabaja en contenidos dignos de ser enlazados, porque cuando otros sitios te mandan usuarios, es señal de que tu contenido mola. Y si encima esos visitantes encuentran valor, ganamos en todo (tráfico, posibles enlaces, branding…).

Enlaces “dofollow”

Aquí entramos en los famosos backlinks tradicionales, aquellos enlaces de otras webs al tuyo que sí transmiten autoridad (llamados dofollow para distinguirlos de los que llevan rel=nofollow). Los enlaces siguen siendo uno de los pilares del algoritmo. Es cierto que Google ha ido refinando cómo los valora (ya no vale cualquiera, prima la calidad sobre la cantidad, detectan esquemas artificiales…), pero un buen enlace sigue valiendo su peso en oro. Por ejemplo, si una revista online de renombre enlaza a tu página de servicios diciendo “…según [TuEmpresa], expertos en X, …”, ese enlace probablemente mejorará tu visibilidad para temas relacionados con X. ¿Por qué entonces no lo he puesto en GOD tier? Bueno, porque a diferencia de la intención de búsqueda o el contenido (que debes sí o sí trabajar tú mismo), los enlaces en parte dependen de terceros.

He visto sitios con contenido tan excelente y marca tan fuerte que, aun con menos enlaces que competidores, logran aparecer arriba. Es decir, los enlaces son importantísimos, pero siempre en contexto: prefiero 10 enlaces buenos y relevantes que 100 de “medio pelo”. En 2025 Google distingue muy bien un enlace editorial genuino de uno spam. Así que enfócate en ganarlos de manera natural: contenido compartible, relaciones públicas digitales, publicaciones de invitados en sitios reputados… Cuando analizo por qué cierto competidor supera a otro, muchas veces la respuesta está en su perfil de enlaces. Sin duda, es un factor a tener muy en cuenta en cualquier estrategia SEO.

Breadcrumbs (migas de pan)

Las migas de pan son esos enlaces jerárquicos típicamente arriba de una página (“Inicio > Categoría > Subcategoría > Página actual”). Aportan navegación clara para usuarios y un rastro de estructura para Google. En términos de SEO, tener breadcrumbs bien implementados (incluso con datos estructurados de breadcrumb) ayuda a que Google “entienda” mejor la arquitectura de tu sitio y, además, a veces los muestra en los resultados de búsqueda en vez de la URL completa.

Seguro has visto en Google un resultado que debajo del título muestra breadcrumbs en vez de la URL. Y no es que por ponerlos vayas a saltar del puesto 10 al 1, pero son importantes como parte de la optimización on-site. Facilitan la indexación, evitan contenido huérfano, y mejoran la experiencia de usuario (alguien perdido en tu web puede volver a categorías superiores fácilmente). En resumen: un pequeño detalle técnico que suma puntos. Muchas plantillas de CMS ya las traen, solo verifica que estén activadas y correctamente enlazadas.

Factores sociales

Este es interesante. Cuando hablo de factores sociales me refiero a la presencia en redes sociales, el número de veces que se comparte tu contenido, menciones en Twitter, Facebook, LinkedIn, etc. Google públicamente ha dicho que las señales sociales no entran directamente en su algoritmo de ranking (no es que por tener 1000 “me gusta” rankeas y con 100 no). Sin embargo, la actividad social puede producir efectos indirectos potentes. Un contenido muy compartido en redes suele generar más visibilidad, lo que puede llevar a más gente enlazándolo desde blogs o foros (volvemos al punto de enlaces externos y tráfico referido). Además, una marca con comunidad activa en redes seguramente tiene más búsquedas de marca, más tráfico directo… cosas que sí reflejan interés y confianza.

Por lo tanto, aunque no es un factor de ranking per se, ignorar lo social sería un error. Piensa en los factores sociales como amplificadores: un buen contenido con apoyo social llega más lejos (y acaba repercutiendo en SEO). Por ejemplo, un estudio interesante que publiques y que la gente comparta en LinkedIn puede atraer a periodistas o bloggers que a su vez te mencionen con un enlace. Todo conectado. Por tanto, cultiva tus canales sociales; no por las posiciones directamente, sino por el ecosistema que rodea tu SEO.

Canonicals

La etiqueta canonical le indica a Google cuál es la versión “canónica” (preferida) de una página cuando tienes contenido duplicado o muy similar en varias URLs. Es un factor técnico importante para evitar contenido duplicado interno y consolidar señales en una sola URL. Imagina un e-commerce con la misma página de producto accesible en dos URLs distintas (quizá una normal y otra con parámetros de tracking). Si no usas canonicals, Google puede liarse o dividir el valor entre ambas. Con un canonical bien puesto le dices “Google, esta de aquí es la principal, las demás son duplicados”. Esto no te hace posicionar más arriba, pero evita problemas que te harían rankear más bajo por dilución de contenido.

Te pongo un caso práctico simple: un cliente tenía un sitio accesible con y sin “www” (dos versiones duplicadas), y no estaba bien configurado el canonical ni la redirección. Google no sabía cuál indexar, así que a veces mostraba la versión “sin www” y otras la “con www”, y los enlaces entrantes se repartían. Lo solucioné forzando todo a una versión y con canonicals apuntando correctamente, y así unifiqué el ranking en una sola URL. Importante: el canonical es una sugerencia, Google a veces la respeta y a veces no si piensa que te equivocas, pero en general es fundamental implementarla donde proceda (páginas de filtros, contenido repetido en varias secciones, etc.). Es parte de esa higiene SEO técnica que, cuando la llevas bien, allana el camino para que el contenido bueno brille sin confusiones.

HTTPS

A estas alturas, cualquier sitio debe estar bajo HTTPS (con certificado de seguridad). Google desde 2014 indicó que HTTPS es un ligero factor de ranking, y aunque es pequeñísimo, importa. Pero más allá de Google, los navegadores marcan como “No seguro” a las webs en HTTP, lo que ahuyenta a usuarios. Se ha convertido en un estándar de facto.

En la práctica, migrar de HTTP a HTTPS te puede dar un mini boost SEO (muy mini, no esperes milagros) pero sobre todo te evita una posible penalización de confianza. Si dos sitios son iguales en todo lo demás y uno no es seguro, Google preferirá el seguro porque quiere proteger al usuario. En 2025, si no tienes HTTPS, estás fuera de juego por desconfianza. Así que más que para ganar ranking, HTTPS es para no perderlo y para dar una experiencia tranquila al visitante.

Como ves, estos factores “importantes” conforman una larga lista de tareas y optimizaciones. Ninguno por sí solo garantiza el éxito, pero juntos suman. En un escenario competitivo donde todos los que rankean en la primera página ya han clavado los factores “GOD”, son estas cosas las que te pueden diferenciar. Un detalle técnico pulido aquí, una mejora de experiencia allá, un backlink extra de calidad obtenido, un rich snippet llamativo… el SEO es una carrera de fondo y estos factores son tus compañeros de viaje que te empujan unos metros más adelante.

Factores Neutros (Ni bien ni mal)

Llegamos a la categoría neutra – aquellos factores de los que se habla pero que, en la práctica, ni fu ni fa. Es decir, no te van a catapultar en rankings, pero tampoco su presencia moderada te hunde (salvo casos extremos). Muchos son aspectos técnicos o mitos a medias que generan debate entre SEOs. En base a mi experiencia, estos factores no merecen desvelos, más allá de tenerlos controlados a un nivel básico. Veamos algunos ejemplos de factores “meh” típicos en 2025:

Crawl budget y profundidad de rastreo

El crawl budget es el número de páginas que Googlebot rastrea en tu sitio en un periodo dado. Para la mayoría de webs pequeñas o medianas, esto es irrelevante: Google llegará sin problema a todo tu contenido (si está bien enlazado) mucho antes de “gastarse” su presupuesto. Optimizar el crawl budget es algo de nicho, útil solo en webs gigantes (piensa en sitios con millones de URLs, como Amazon o Wikipedia). Si tienes un sitio de 500 o 5000 páginas, no necesitas volverte loco con esto. Basta con no generar miles de URLs inútiles (por ejemplo, si tienes un calendario infinito o parámetros duplicando páginas).

Un ejemplo: un ecommerce con decenas de miles de combinaciones de filtros podría desperdiciar crawl budget en páginas similares; ahí sí conviene bloquear vía robots.txt o noindex ciertas secciones. Pero fuera de casos así, no notarás impacto en rankings por “optimizar” tu presupuesto de rastreo. Igualmente, la profundidad (que ninguna página importante esté enterrada a 10 clics de la home) es más que nada sentido común y se soluciona con buen enlazado interno, no tocando el algoritmo. En resumen, ocúpate del crawl budget solo si tu site es enorme o Google no llega a páginas importantes; en condiciones normales, es un factor neutro que no va a mejorar tu posición porque sí.

Robots.txt y Sitemap XML

Tener un archivo robots.txt correcto y un sitemap XML son prácticas recomendadas, pero su influencia directa en rankings es neutra. El robots.txt sirve para decir a Google qué no rastrear (por ejemplo, evitar que pierda tiempo en páginas irrelevantes como /admin/ o filtros sin contenido único). Un buen robots.txt ayuda a enfocar a Google en lo importante, pero si tu robots.txt es estándar y no bloquea nada crítico, no hay mucho más que rascar. No vas a rankear mejor por tener un robots.txt impecable; simplemente evitarás problemas.

Pasa algo similar con el sitemap: enviar a Google un sitemap XML le facilita encontrar tus URLs, sobre todo si tu web es nueva o tiene una estructura compleja. Pero una vez tus páginas están indexadas, el sitemap no les da un boost extra ni nada. Es neutro: ayuda a la indexación inicial y a descubrir contenidos, pero no afecta la ponderación que Google da a cada página. En otras palabras, tanto robots.txt como sitemaps son aspectos técnicos necesarios (como poner gasolina al coche) pero no son turbo ni lastre en la carrera SEO; solo aseguran que el crawler vaya por buen camino.

Pogo-sticking y CTR orgánico

El pogo-sticking es ese comportamiento cuando un usuario entra a un resultado de Google y rápidamente vuelve atrás porque no encontró lo que quería, posiblemente haciendo clic en otro resultado. Y el CTR (click-through rate) orgánico es la tasa de clics que tu resultado obtiene en la SERP. Ambos son indicadores de calidad/rendimiento percibida, pero Google ha afirmado que no los usa directamente como factor de ranking (al menos de forma general). ¿Por qué? Porque serían muy “ruidosos”: un resultado podría tener mucho CTR simplemente por estar en posición 1 (es lo normal), no necesariamente por ser el más relevante. Dicho esto, es lógico pensar que Google preste algo de atención a señales de satisfacción del usuario. Pero no está claro cómo. En 2025, la mayoría estamos de acuerdo en que no vale la pena obsesionarse con “manipular” CTR o pogo-sticking.

He visto a gente intentar de todo, desde títulos sensacionalistas para ganar clics hasta bots para simular clics, y sinceramente, si el contenido no respalda, no hay mejora sostenible. Lo mejor es optimizar tus snippets (título y descripción) para que sean atractivos y fieles al contenido, así quien haga clic se quedará. Si tienes un CTR bajísimo comparado con la media, quizá tu título no es relevante o tu meta description espanta al usuario; mejorarlo te puede traer más tráfico porque más gente hará clic, pero es consecuencia de una optimización de marketing más que de SEO puro. En resumen: el CTR y el pogo-sticking son factores medio nebulosos; enfócate en ellos indirectamente haciendo buenos títulos y contenidos que mantengan al usuario feliz, en vez de verlos como palancas directas de ranking.

Contenido generado con IA

Bien, el tema de moda. ¿Vale el contenido hecho por inteligencia artificial (tipo ChatGPT) para SEO? A día de hoy, Google no penaliza el contenido generado por IA per se, pero tampoco lo premia mágicamente. La clave sigue siendo la calidad y originalidad. Si generas contenido con una AI y éste es insulso, repetitivo o no aporta nada nuevo, rankeará mal (no porque sea de AI, sino porque es mediocre). He experimentado con textos AI en algunos sitios nicho: cuando los usaba tal cual, sin “curación” humana, el resultado era neutro o incluso negativo (páginas que no despegaban).

En cambio, si utilizas la IA como ayuda para luego pulir, aportar datos propios, corregir y enriquecer, puedes obtener contenido decente. Conozco bloggers que aceleraron su producción de contenido con IA, pero siempre dotándolo de su expertise después. El resumen es: un artículo escrito 100% por una máquina no va a superar a uno escrito o revisado por un experto humano en cuanto a E-E-A-T. Google cada vez detecta mejor la utilidad del contenido, que suele requerir ese toque humano (actualidad, experiencia real, ejemplos auténticos).

Así que verás mucha IA en la web, pero quien la use sin cabeza no obtendrá gran beneficio SEO. En esta tier list lo pongo neutro porque no es un factor que te impulse salvo que logres que el resultado final sea tan bueno como lo haría un redactor experto. Úsala con precaución: puede ser tu aliada para borradores, pero la varita mágica de posicionamiento sigue sin ser automática.

Optimización de URLs (palabras clave en la URL)

Hubo un tiempo feliz en que tener la palabra clave exacta en la URL ayudaba bastante. Por ejemplo, misitio.com/mejor-camara-2020.html podía rankear mejor por “mejor cámara 2020” que misitio.com/prod1234.html. ¿Hoy? La influencia de incluir keywords en la URL es mínima, tirando a nula. Google apenas le da importancia una vez que la página está indexada. Lo relevante está en el contenido y otros factores, no en la cadena de texto de la URL. Ojo, eso no quiere decir que descuides las URLs: es bueno que sean limpias, cortas y descriptivas, porque mejora la experiencia del usuario y un poquito la comprensión (además de que alguien las enlace es más probable si la URL “tiene sentido”).

Pero más allá de eso, no te mates renombrando todas tus URLs para meter keywords creyendo que escalarás posiciones. He visto gente romper sitios haciendo redirecciones masivas para “mejorar URLs” sin ganancia alguna en SEO. Mi regla: si puedes poner la palabra clave principal en la URL de forma natural al crear la página, hazlo (ej: /camaras-reflex en lugar de /cat?id=123). Pero no porque Google te vaya a rankear mejor, sino porque es más claro. Y si tu URL ya es legible, no pasa nada si no tiene todas las keywords. Más vale una URL estable con historial que andar cambiándola por capricho SEO. En resumen, URL amigable sí, pero obsesión por keyword en URL no.

Nombre de imágenes y atributo ALT

Incluir palabras clave en el nombre de archivo de la imagen (mi-producto-super.png en vez de IMG0001.png) y sobre todo rellenar el atributo ALT (texto alternativo) con descripción de la imagen, son buenas prácticas de SEO… para la búsqueda de imágenes y accesibilidad. Sin duda ayuda a posicionar en Google Imágenes y a que usuarios con lectores de pantalla entiendan la imagen. ¿Pero influye en el ranking web general? Muy poco. El ALT puede contribuir marginalmente a indicar relevancia de la página (es texto que Google lee), pero su peso es bajísimo comparado con, digamos, el propio contenido textual o el título. Aun así, yo siempre recomiendo poner ALT descriptivos porque nunca está de más y es útil en otros aspectos.

Simplemente, ten claro que optimizar los nombres de 100 imágenes de tu post no hará que pases del puesto 8 al 3. Es neutro de cara a ranking orgánico estándar. Ahora, si tu estrategia incluye Google Images o buscas aparecer en resultados enriquecidos (como imágenes en la búsqueda web), entonces sí es importante. Pongamos un caso: una tienda de moda que optimiza ALT y nombres de imagen, verá que muchas de sus fotos de producto aparecen en Google Images y traen tráfico. Pero el puesto de la página de producto en la búsqueda web de Google no cambiará solo por eso. Así que útil sí, pero en nuestro contexto de ranking general: factor neutral.

Hreflang (etiquetas de idioma/región)

Las etiquetas hreflang indican a Google qué versiones regionales o idiomáticas equivalentes tienes de una página (por ejemplo, página en español y en inglés del mismo contenido). Esto no mejorará tu ranking, solo asegura que Google muestre al usuario la versión adecuada de tu sitio según su idioma o país. Es decir, evita que compitas contigo mismo en diferentes idiomas y que un español vea la página en inglés o viceversa. Si tu web es monolingüe, este factor ni se tiene en cuenta (neutro total). Si es multi-idioma o multiregional, implementar bien hreflang es importante para la experiencia, pero no es que por tener hreflang vayas a posicionar más arriba: simplemente posicionarás en tu ámbito correcto. Así que, factor importante para direccionar tráfico, pero neutral en cuánto “puntos de SEO” te da. El error sería no usarlo cuando debes, ya que confundiría a Google. Pero haciéndolo bien, cumples y punto.

Actualizaciones/frescura de contenido

Google tiene algo llamado “Query Deserves Freshness” para ciertas búsquedas que requieren información reciente (noticias, tendencias, algo de 2025 obviamente). En esos casos, la “frescura” sí es un factor: un artículo actualizado de este año puede superar a uno de hace tres años aunque sea muy bueno, simplemente porque la búsqueda demanda novedad. Pero fuera de esos escenarios, la frescura es un factor neutro e incluso irrelevante. Un contenido evergreen (atemporal) no va a posicionar mejor por el hecho de que lo edites cada mes cambiando un par de frases. He visto sitios que actualizan la fecha sin realmente cambiar nada, pensando que así Google los subirá… y no funciona así. Si tu contenido se queda obsoleto, ahí sí actualízalo a fondo porque mejorarás su calidad y pertinencia (y de paso la fecha nueva le indica a Google que lo revisaste). Pero actualizar solo por “estar fresco” es un mito común.

Me preguntan: “¿Cada cuánto tengo que actualizar mis posts para que Google me quiera?”. Respuesta: cuando lo necesiten, no por calendario. Hay blogs con artículos de 2015 que siguen top 1 porque su info sigue siendo la mejor respuesta. Y hay otros que necesitan refresco semanal. Así que la frescura es situacional. En general, no es factor determinante salvo en nichos donde la actualidad manda (noticias, tecnología muy cambiante, etc.). Diríamos que es neutro: no suma si no hace falta, pero ojo, puede restar si tu contenido se envejeció y quedó incorrecto.

Anchor text interno y externo

Es el texto visible de un enlace. Antiguamente, el anchor text de enlaces externos era EL FACTOR para rankear por keywords (“mira, todos enlazan a esta página con ‘mejores seguros de coche’, debe ser la más relevante para eso”). Hoy, Google sigue usándolo para entender de qué va la página destino, pero le da mucho menos peso porque se abusó muchísimo en el pasado (link building con anchor sobreoptimizados). Un anchor text externo muy optimizado puede incluso levantar sospechas de spam. Por tanto, diría que el anchor text externo es neutral tirando a ligeramente importante: ayuda si viene de forma natural en enlaces de calidad, pero no intentes controlarlo demasiado.

He visto perfiles de enlaces “perfectos” con 60% anchors de keyword caer penalizados por Penguin en su día; esa lección la tenemos aprendida. Lo verdaderamente importante es que el enlace venga de una página/contexto relevante; el texto específico del enlace ya es secundario. Sobre el anchor text interno, ese sí tienes libertad de optimizarlo porque es dentro de tu web. Úsalo lógicamente: en vez de “haz clic aquí”, mejor “ver nuestros planes de seguros de coche” como enlace, por ejemplo. Ayuda ligeramente a Google a saber de qué trata la página destino, pero de nuevo, no es un factor que por sí solo te suba puestos.

Es más una cuestión de usabilidad y de añadir contexto. Con la comprensión semántica que tiene Google ahora, incluso si tus anchors internos no son exactos, va a entender la relación. Así que coloco el anchor text en neutro: importante como buena práctica, pero ningún sitio fracasa o triunfa exclusivamente por sus anchor texts a estas alturas.

Redirecciones (301/302)

Tener redirecciones bien hechas es higiene SEO. Cuando cambias la URL de una página, pones una redirección 301 a la nueva para no perder el tráfico ni los enlaces. Pero una redirección en sí misma no te da mejoras de ranking, simplemente preserva lo que tenías. Por ejemplo, si tienes una página en la posición 5 y la mueves de /servicio1 a /servicios/consultoria con un 301, lo normal es que siga posicionando similar (puede haber una leve pérdida temporal mientras se asienta, pero se recupera). No es que por redirigir vayas a subir al top 1.

Ahora bien, gestionar mal las redirecciones sí puede hacerte perder (si no las pones, pierdes todo el valor de los enlaces de la URL antigua, etc.). O tener cadenas de redirecciones larguísimas puede ralentizar y afectar la experiencia. Pero asumiendo que no cometes errores, las redirecciones son neutras: ni suman ni restan a nivel de ranking, solo aseguran que no se desperdicie lo ya logrado. Un consejo, eso sí: evita redirecciones innecesarias. Si tienes enlaces internos que apuntan a URLs viejas que redirigen, actualízalos a la nueva URL directa; cosas así mejoran la eficiencia del rastreo. Pero estamos hilando fino. En resumen: configura las redirecciones apropiadas cuando toque y no pienses más en ellas, que su función es invisible pero importante por detrás.

Enlaces “nofollow” y UGC

Los enlaces con rel=”nofollow” (o UGC, o Sponsored) le indican a Google que no considere ese enlace a efectos de ranking. Básicamente, no pasan “Link Juice”. Así que por definición, da igual cuántos enlaces nofollow apuntan a tu sitio: no te transmitirán autoridad ni te harán subir. Muchos perfiles en foros, comentarios o notas de prensa vienen con enlaces nofollow; está bien, traen tráfico quizá, pero no cuentan para SEO. Este factor es neutro porque ni tener muchos nofollow te perjudica (Google simplemente los ignora para ranking), ni tenerlos te beneficia (más allá del tráfico indirecto). Ojo, alguna vez Google ha dicho que los nofollow ahora se tratan como “hint” (una pista que podrían o no seguir), pero en general la industria sigue asumiendo que no aportan valor SEO directo.

Un ejemplo: un cliente me preguntaba por qué un competidor le ganaba si “tenemos más enlaces”. Revisé y resulta que los suyos eran mayormente nofollow (en perfiles de directorios, por ejemplo), mientras que el competidor tenía menos enlaces pero dofollow de blogs reales. Ahí está la diferencia. En conclusión, persigue enlaces que sean follow; los nofollow están bien para variedad de perfil o para tráfico, pero no cuentan en tu autoridad. Este punto incluye los de tipo UGC (User Generated Content) que es básicamente un nofollow para contenidos de usuarios, y Sponsored (para enlaces pagados), todos indican a Google que no los use para rankear. Así que, neutro total desde la perspectiva de “subir posiciones”. No gastes energías buscando mil enlaces nofollow; mejor ten unos pocos follow buenos.

Renderizado de página (JavaScript)

Con la proliferación de frameworks JS (React, Angular, etc.), a veces el contenido de la página se construye dinámicamente en el navegador. Si Google no renderiza ese JS, podría no ver tu contenido. Hoy por hoy, Google sí es capaz de renderizar JavaScript en la mayoría de casos, sólo que puede hacerlo con un poco de retraso. Si tu sitio depende completamente de JS para mostrar contenido crucial, es importante asegurarse de que Google lo pueda renderizar o proporcionar contenido prerenderizado. Pero suponiendo que lo haces bien y Google ve tu página correctamente, no hay diferencia de ranking por ser JS o HTML estático.

Lo menciono porque he visto preguntas como “¿Google posiciona peor las páginas en React?”. La respuesta: no, mientras pueda leer el contenido igual de bien. Así que este factor es neutro siempre que tu implementación sea correcta. Si es incorrecta (Google no ve nada de tu página porque el JS falla), obviamente afectará negativamente, pero eso es más un error grave que un “factor neutro”. En resumen: asegúrate de que tu contenido sea accesible al bot. Si lo es, el cómo se generó le da igual. Muchos sitios SPA (Single Page Applications) rankean genial tras solventar temas de render. Así que el renderizado es más un potencial obstáculo técnico que debes superar; una vez superado, no influye en tu posición como tal.

Como se puede apreciar, estos factores neutros son en su mayoría detalles técnicos o métricas de las que se habla mucho en blogs, pero que no van a definir tu éxito SEO. Mi consejo profesional: cúbrelos hasta un nivel aceptable y céntrate en lo importante. Por ejemplo, pon un sitemap, sí, pero no gastes horas optimizándolo semanalmente. Ten buena velocidad, pero no te obsesiones en bajar de 1,5s a 1,4s si ya estás rápido. Publica contenido útil sin pensar “¿y si no pongo esta palabra clave 5 veces perderé densidad?”.

Al final, estos factores “ni bien ni mal” son como el colesterol bueno: mejor tenerlos bajo control, pero no son por sí mismos garantía de estar sano – para eso están los factores esenciales y importantes. No es que debas ignorarlos, sino manejarlos con equilibrio y no permitir que desvíen tu atención de lo que de verdad importa.

Factores Irrelevantes (sobrevalorados o anticuados)

Ahora entramos a la penúltima categoría de nuestra tier list: factores irrelevantes. Son aquellos que en su día pudieron tener cierta influencia o que mucha gente cree que importan, pero que en la realidad actual no tienen efecto apreciable en el posicionamiento. Dedicar esfuerzos a estos es, francamente, perder el tiempo (o peor, puede que estés haciendo algo contraproducente pensando que ayudas). Voy a repasar los principales mitos/elementos sobrevalorados que escucho con frecuencia y por qué no deberías preocuparte (en serio, olvídate de ellos):

Errores de rastreo

Me refiero a los famosos “crawl errors” que ves en Google Search Console (páginas no encontradas, servidor no disponible, etc.). Tener errores de rastreo no es un factor de ranking en sí. Obviamente quieres minimizarlos porque si Google no puede acceder a una página importante, esa página no va a posicionar (porque ni la indexa). Pero más allá de eso, una vez has solucionado tus 404 importantes con redirecciones o quitándolos del sitemap, ya está. No hay una medalla SEO por tener “0 errores” en Search Console. Es simplemente el estado normal.

En cambio, he visto gente obsesionada comprobando cada día si hay un 404 nuevo y pensando que eso hundirá su web entera… calma. Arregla lo rompido, sí, pero entender que la ausencia de errores es el estado esperado y no te da un plus, solo te evita un negativo. Piensa: Google no te va a rankear mejor porque todas tus páginas devuelvan 200 OK, ¡es lo mínimo! Así que este factor es irrelevante más allá de mantener la casa en orden.

Longitud del contenido

“¿Cuántas palabras ha de tener un artículo para posicionar #1?” Si me dieran un euro por cada vez que me preguntan esto… No hay un número mágico. La creencia de que “más largo = mejor SEO” está desfasada. Y eso que este artículo es largo de narices. Sí que es cierto que Google espera cierta “profundidad” para según qué consultas (difícil explicar algo complejo en 100 palabras), pero una vez cubres la intención de búsqueda de forma satisfactoria, el largo que tenga es el que tenga.

He posicionado artículos de 800 palabras por encima de otros de 2000 porque iban al grano y resolvían mejor la pregunta del usuario. Y también casos al revés. Ojo, no confundir: no es que el contenido corto sea mejor, es que la calidad y relevancia mandan, no la cantidad de palabras. Si con 700 palabras respondes todo lo necesario, meter “paja” hasta llegar a 2000 sólo lo hará peor. Google se ha vuelto bueno detectando verborrea y contenido de relleno sin valor. También he visto webs recortar contenido superficial y consolidarlo, y mejorar en SEO por quitar “lastre”. Así que olvida la regla de “mínimo X palabras”. No querrás ni el artículo escueto que deja dudas ni el quijote interminable que aburre. Querrás el contenido completo justo, ni más ni menos.

En resumen: la longitud en sí misma no posiciona. Es irrelevante cuántas palabras uses siempre que cubras la necesidad del usuario. (Consejo: fíjate en tus competidores top: si todos tienen guías largas, probablemente el tema requiera extensión; si son cortos y concretos, quizás los usuarios quieren rapidez. Adapta la longitud a lo que el usuario espera, no a un supuesto estándar SEO).

AMP (Accelerated Mobile Pages)

AMP fue la iniciativa de Google para páginas móviles ultraligeras. En su momento (hace unos años), tener AMP podía ser beneficioso porque Google lo priorizaba para ciertas características (por ejemplo, salir en el carrusel de noticias Top Stories requería AMP). Pero en 2025 AMP ha perdido relevancia; Google ya no lo exige para casi nada y muchas webs incluso lo han abandonado. ¿Influye AMP en SEO ahora? Prácticamente no. Si tu sitio normal es rápido y responsive, no necesitas AMP. De hecho, mantener dos versiones (AMP y normal) puede ser un dolor de cabeza. He visto portales de noticias quitar AMP tras ver que ya no les aportaba ventaja, sin afecto negativo en su posicionamiento general.

Al final, lo que importaba de AMP era la velocidad; hoy esa velocidad la puedes lograr con buenas prácticas web estándar (y Core Web Vitals). Así que AMP como tecnología no te da puntos extras. Es irrelevante usarla o no desde la perspectiva de ranking puro. Solo tendría sentido en algún caso específico de optimización extrema, pero vamos, la mayoría de sitios no la necesitan. Google trata igual de bien una página móvil rápida hecha a mano que una AMP. Así que no inviertas esfuerzo en implementar AMP pensando en SEO; inviértelo en hacer tu web rápida independientemente del formato.

Meta description

La metadescripción es ese resumen que pones en el <meta name="description"> de cada página, que a veces Google muestra como fragmento en los resultados. No es un factor de ranking. Google no posiciona tu página por lo que diga la metadescripción (es más, a menudo ni la utiliza si cree que otra parte del contenido sirve mejor de snippet). Entonces, ¿es irrelevante? En términos de algoritmo, sí, la descripción no afecta al ranking. Sin embargo, tiene un rol en persuadir al usuario a hacer clic. Yo recomiendo escribir metadescripciones atractivas para mejorar tu CTR (aunque Google a veces las reemplace). Pero hay que aclarar esta confusión común: no, meter keywords en la meta descripción no te hace más relevante para Google. Ni por densidad, ni por nada. Es puramente un elemento de experiencia de búsqueda.

Así que no gastes tus energías tratando de optimizar la meta description como si fuera a sumarte puntos SEO. Pon algo que venda bien tu contenido a los humanos y ya está. Si la dejas vacía, Google generará una automáticamente y tu página puede posicionar igual; quizás baje un pelín el CTR por ser menos “marketing”, pero si el título es bueno, poca diferencia habrá. En definitiva, meta description no influye en cómo Google rankea tu página, pero sí puede influir en si el usuario te elige en la lista. Considera su importancia secundaria en tu estrategia.

Exact Match Domain (EMD)

Los EMD son dominios que coinciden exactamente con una palabra clave (por ejemplo, comprarzapatos.com para “comprar zapatos”). Hubo una era dorada donde tener un EMD te daba un empujoncito extra – tanto que proliferaron sitios de baja calidad con dominios exactos colándose arriba. Google ajustó eso con el EMD update hace ya tiempo. Hoy, tener la keyword en el dominio es irrelevante o tiene un peso minúsculo. Un dominio creativo puede posicionar igual de bien que uno con palabra clave, siempre que el sitio detrás sea bueno. Por ejemplo, amazon.com rankea de maravilla en mil categorías sin llevar “tienda-online” en el nombre.

En cambio he visto montones de dominios exactos como mejorescreditos.com llenos de contenido pobre perdidos en página 5. ¿Por qué alguna gente sigue optando por EMD? Bueno, pueden tener ventaja en cuanto a clics o recordación (un usuario puede pensar “esta web debe ser justo lo que busco”), pero Google no se deja engañar solo por el nombre. Si me preguntas, elige tu dominio por branding antes que por SEO. Si calza la palabra clave y suena bien, fantástico, pero no creas que por comprar keyword1-keyword2.com ya tienes garantizado nada.

Pro tip: a veces un ligero beneficio de un EMD es que si otros sitios te enlazan naturalmente, a veces usan tu nombre de dominio como anchor, que contiene la keyword — pero esto es circunstancial. En resumen, tener o no un EMD no definirá tu ranking; es irrelevante en el algoritmo moderno. Mucho más importante es la calidad del sitio y enlaces.

Negritas y formateos de texto

¿Es cierto que si pongo en negrita mis palabras clave Google me va a entender mejor y posicionar más alto? No, eso es prácticamente un mito. Destacar texto puede ayudar al usuario a escanear la info, pero Google no le da un peso especial a las palabras en bold para ranking. Hubo algún experimento hace años que sugería que la negrita podía mejorar ligeramente la relevancia de un término, pero con la inteligencia semántica que tiene Google hoy, no necesita que se lo mastiquemos así. Si usas negrita, que sea para resaltar puntos importantes de cara al lector. No por SEO. Igual con cursivas, subrayados, etc.

He revisado sitios donde literalmente habían puesto en negrita cada aparición de la keyword… y obviamente eso no marcó diferencia (más que verse spammy para el usuario). Google incluso ha dicho que estos trucos visuales no impactan cómo rankea las páginas. Así que, irrelevante total en el algoritmo. Úsalos pensando en la experiencia de lectura, nada más.

Enlaces “sponsored” (patrocinados)

En la etiqueta anterior de factores neutros hablé de los enlaces nofollow. Los enlaces marcados como rel="sponsored" son básicamente lo mismo: le indican a Google “este enlace es de publicidad o patrocinado, no lo tengas en cuenta para SEO”. Por tanto, cualquier enlace etiquetado así no transmite autoridad. Consecuencia: si compras enlaces (cosa que no recomiendo) o haces colaboraciones donde te marcan el enlace como sponsored, ese enlace no te ayuda a rankear. Podrá traer visitas si es un buen sitio, sí, pero SEO value, cero. Google lo ignorará igual que un nofollow.

Entonces, ¿tener enlaces sponsored perjudica? No directamente; es simplemente como si no existieran a nivel de PageRank. Lo negativo sería gastar dinero o esfuerzo en ellos esperando mejora de ranking, porque no la habrá. Aclaración: si un día ves en tu perfil de enlaces que tienes varios rel=sponsored, no entres en pánico – Google te dijo que los ignorará, así que todo bien. Este factor es irrelevante para posicionamiento. Lo relevante es que si haces link building legítimo, busques enlaces que no lleven ese atributo (ni nofollow), porque si no, estarás trabajando en vano para SEO. En fin, sponsored o nofollow = mismas reglas, no cuentan.

Tasa de rebote (bounce rate)

Uno de los temas más malinterpretados. La tasa de rebote es el porcentaje de usuarios que entran a una página y se van sin navegar a otra página de tu sitio. Mucha gente cree que un bounce rate alto hará que Google te baje, porque entiende que “la gente no encontró lo que buscaba”. La realidad: Google ha dicho que no usa Google Analytics ni la tasa de rebote como factor de ranking directo. ¿Por qué? Porque el bounce rate es engañoso: si alguien entra, lee todo tu artículo por 5 minutos y se va satisfecho sin clicar nada más, técnicamente es un rebote… ¡pero fue un éxito! Otro entra y en 10 segundos se va de vuelta a Google (pogo-sticking), ese rebote sí indicaría insatisfacción.

Google no tiene manera fiable de distinguir eso solo con la métrica de Analytics, y además no todos los sitios usan Analytics (sería injusto). Así que no, un bounce rate alto por sí solo no te penaliza. De hecho, páginas de consulta rápida (clima, definiciones, etc.) suelen tener rebotes altísimos y posicionan #1 igual, porque responden al usuario de inmediato. Esto no quiere decir que debas ignorar la tasa de rebote: es útil para ti, para diagnosticar posibles problemas de UX o de contenido. Si un artículo tiene 95% de rebote en 10 segundos, quizá no está cumpliendo su cometido. Mejora eso y posiblemente retendrás más gente, y eso indirectamente puede ayudar (más tiempo en página, etc.).

Pero lo importante: no pienses que Google tiene un umbral de rebote para bajarte de ranking. No hay evidencia de eso. Concéntrate en la intención de búsqueda y la experiencia; si lo haces bien, muchos usuarios ni siquiera necesitarán visitar otra página tuya (y rebotarán felizmente tras obtener su respuesta). En definitiva, la tasa de rebote es un indicador para ti, no un factor que Google use en su algoritmo de clasificación.

En suma, estos factores “irrelevantes” son aquellos que puedes tachar de tu lista de preocupaciones SEO. Dedicar tiempo a ellos no te va a dar retorno en posicionamiento. Si algo he aprendido en 20 años es a priorizar: los recursos son limitados y es mejor invertirlos donde hay impacto real. Así que olvida los amuletos sin efecto (como poner todo en negrita o obsesionarte con 100 palabras más o menos) y enfoca tu estrategia en los factores que de verdad cuentan.

Mitos del SEO

Por último, en la tier list tenemos la categoría Mitos. Son creencias muy extendidas – muchas veces por información desactualizada o malentendidos – que realmente no tienen base en cómo funciona Google hoy. Ya hemos tocado varios a lo largo del artículo, pero hagamos un repaso rápido de los principales mitos que aún en 2025 escucho de vez en cuando. Esto es casi un hall of fame de “consejos SEO” que en realidad no sirven:

“La caducidad del dominio mejora el SEO”

– Mito: Registrar tu dominio a muchos años vista (por ejemplo hasta 2035 en lugar de que expire en 2026) te hace ver más confiable para Google y por tanto te sube en rankings. He administrado sitios con dominio renovado año a año que rankean estupendamente. Mientras pagues a tiempo y tu web no se caiga, a Google le da igual si expiraba en uno o diez años. Así que no gastes dinero de más en registrar por lustros pensando en SEO; hazlo solo por comodidad o seguridad de no olvidarte cada año, pero sabiendo que no obtendrás ventaja en buscadores.

– Realidad: Google no utiliza la información de caducidad de dominio para el ranking. Es un mito viejísimo nacido de un comentario en un patente hace más de 15 años. Pero Google ha negado expresamente que renovar un dominio por más tiempo influya en SEO

“La antigüedad del dominio da ventaja”

– Mito: Un dominio antiguo rankea mejor; los dominios nuevos están en desventaja o penalizados (“sandbox”, ahora hablo de eso). Lo que ocurre es que un dominio antiguo suele haber tenido más tiempo para conseguir enlaces, contenido, etc., y eso sí ayuda. Pero si hoy compramos un dominio que existe desde 1998 pero nunca tuvo nada, no va a rankear más fácil que uno registrado ayer si ambos empiezan de cero. Google valora el contenido y los enlaces, no la edad del Whois.

Incluso John Mueller lo ha dicho claramente: “la edad del dominio no importa, la calidad del sitio sí”. Así que, no descartes lanzar un proyecto nuevo porque “mi dominio es nuevo, jamás podré con los veteranos”. Con trabajo, puedes. Y no pienses que por comprar un dominio viejo expirado vas a heredar un trato de favor; puede ayudar si trae enlaces existentes, pero no por la edad intrínseca.

– Realidad: No hay un factor de “edad” que haga rankear mejor a un dominio viejo por el mero hecho de ser viejo

“Google Ads ayuda al posicionamiento orgánico”

– Mito: Si inviertes en Google Ads (AdWords) y pones anuncios, Google te tratará mejor en los resultados orgánicos, o al revés, si no pagas nunca, te penaliza.

– Realidad: El departamento de búsquedas orgánicas y el de anuncios en Google están totalmente separados. Comprar anuncios no afecta tu SEO ni positiva ni negativamente. Google tiene mucho cuidado en esto por tema de confianza y posibles acusaciones de monopolio; siempre ha mantenido que la publicidad no influye en el ranking orgánico y viceversa. Tengo clientes que gastan miles de euros en Ads y sus posiciones orgánicas suben o bajan según sus méritos SEO, no por la chequera. Y conozco webs que jamás han invertido un euro en Ads y lideran su sector en orgánico.

Son canales distintos. Es más, a veces los anuncios compiten con tus clics orgánicos (si saturas de anuncios quizá tu CTR orgánico baja un poco), pero Google no te da un boost orgánico por ser buen cliente de Ads. Así que, quítate ese mito de la cabeza: invierte en Ads si quieres tráfico inmediato y segmentado, pero no como atajo para SEO. No hay tal atajo. (Matt Cutts y otros lo han repetido mil veces, y tras tantos años puedo corroborar que es cierto).

“La densidad de palabras clave ideal mejora el ranking”

– Mito: Necesitas repetir la palabra clave X veces para tener un porcentaje perfecto (2%, 5%, lo que sea) y así Google te considerará relevante.. Un experimento mental: ¿Qué preferirías leer, un texto claro que te resuelve la duda, o uno donde cada dos líneas mete la misma frase clave forzada? Google piensa lo mismo que tú. Mi recomendación: usa la palabra clave principal en lugares lógicos (título, algún subtítulo, en el texto inicial) y luego escribe con naturalidad profundizando en el tema. Si haces eso, sin darte cuenta seguramente incluirás variaciones y términos relacionados, que es lo que realmente mejora la relevancia. No un porcentaje mágico.

– Realidad: No existe una densidad de palabra clave óptima. Google no cuenta keywords como en los 2000. De hecho, sobreoptimizar repitiendo mucho puede ser contraproducente (suena antinatural o te arriesgas a keyword stuffing). Google entiende sinónimos, contexto y campos semánticos. Si tu artículo es sobre “coches eléctricos baratos”, no tienes que poner “coches eléctricos baratos” veinte veces; con que lo menciones naturalmente y hables del tema (autonomía, precio, modelos, etc.), Google pilla de qué va. La obsesión con la densidad es un mito antiguo – en su día se hablaba de 3-5% como ideal, pero eso nunca fue científico. La calidad del contenido es lo que importa, no cuántas veces repites una frase

“La meta keyword sirve para algo”

– Mito: Rellenar la etiqueta <meta name="keywords"> en tu HTML ayudará a indicar a Google tus palabras clave objetivo.

– Realidad: Google no utiliza la meta keywords para nada. Esta etiqueta está muerta para SEO desde hace más de una década. Fue abusada en los 90s y 2000s (todo el mundo ponía listas interminables de keywords, a veces ni relacionadas), y Google decidió ignorarla por completo. De hecho, en 2009 ya anunció oficialmente que no la toma en cuenta para el ranking. Otros buscadores pequeños quizás la leen, pero Google no. Hoy en día casi ninguna herramienta SEO te la pide.

Si tu CMS tiene un campo para meta keywords, puedes dejarlo vacío sin problema. Es más, he visto casos donde algún competidor pillo miraba las meta keywords de otros para inspirarse… así que mejor ni las tengas expuestas. En resumen: dedicar un segundo a meta keywords es dedicar un segundo de más. Es totalmente irrelevante para Google y demás motores principales.

“El Sandbox de Google (los sitios nuevos no rankean)”

– Mito: Google aplica una penalización temporal a sitios web nuevos impidiéndoles rankear bien hasta que “demuestren antigüedad” (lo que la gente llama sandbox, como si tu web estuviera en una caja de arena aislada un tiempo).

– Realidad: No hay evidencia de un sandbox general aplicado a todos los sitios nuevos. Lo que ocurre es que un sitio nuevo tiene que ganarse su posición: parte sin enlaces, sin reputación, puede tardar meses en acumular contenido e historial. Y en sectores competitivos, es lógico que de inicio no salgas primero hasta que vayas construyendo autoridad. Pero no es una penalización deliberada por ser nuevo; es simplemente el terreno que hay que labrar. De hecho, he visto sitios nuevos rankear muy bien a los pocos meses cuando dieron en el clavo con nichos de baja competencia o contenido excepcional.

Google no tiene interés en “esconder” contenido nuevo si es bueno; al contrario, a veces lo favorece si aporta frescura. Este mito persiste porque muchos novatos lanzan web y esperan estar en top 10 en un mes – cosa poco realista en la mayoría de casos. Entonces culpan al “sandbox”. La verdad suele ser: o el nicho es competido y necesitas más trabajo, o tu estrategia no fue la mejor. Así que mi consejo: ignora la idea de un sandbox misterioso. Concéntrate en mejorar tu web. Si haces lo correcto, podrás rankear incluso siendo nuevo, tal vez no para “seguros” o “hoteles” ultra competidos en dos semanas, pero sí irá subiendo. Paciencia sí, penalización por juventud no.

Podríamos seguir con más mitos menores, pero estos son los grandes que quería aclarar. El SEO tiene su dosis de leyendas urbanas, y es importante filtrarlas, porque si no puedes acabar gastando esfuerzo en fantasmas. Siempre que oigas un “truco mágico” o una teoría conspirativa sobre Google, toma un paso atrás y busca confirmación en fuentes fiables o experimentos propios. En mi larga trayectoria, cada cierto tiempo aparece el “nuevo secreto SEO” que resulta humo. Al final, los fundamentos cambian poco: contenido, enlaces, experiencia… lo demás son adornos.

Conclusión: Evolución del SEO y mantenerse al día

Hemos recorrido una buena lista de factores, separándolos en nuestro Tier List SEO 2025 particular, basándome en dos décadas de tropezar y triunfar con sitios web. ¿Qué conclusiones sacamos de todo esto?

Primero, que el SEO en 2025 sigue girando en torno al usuario. Si te fijas, nuestros factores GOD (intención, contenido de calidad, E-E-A-T, etc.) tienen todos un hilo común: aportar valor real y satisfacer al usuario. Google, con todos sus cambios de algoritmo a lo largo de los años, no ha hecho más que acercarse cada vez más a un ideal: clasificar arriba las páginas que mejor responden a lo que la gente busca. Ni más ni menos. Por eso, cada vez penaliza más las trampas o atajos (como el keyword stuffing, los enlaces artificiales, etc.) y premia la relevancia genuina.

Content is king

Sí, pero matizado:

“Quality content is king, supported by a good kingdom (técnica, enlaces, UX)”

Podríamos decir.

Segundo, que priorizar es fundamental. No puedes abordarlo todo a la vez, y menos si tienes recursos limitados. Esta tier list nos sirve para saber dónde enfocarnos primero. Cubre a la perfección los factores imprescindibles (si fallas en ellos, ningún otro te salvará). Luego trabaja los importantes, que te darán ese empujón extra. Los neutros, tenlos simplemente controlados para que no perjudiquen, pero no malgastes horas optimizando lo intrascendente. Y olvida de una vez los mitos e irrelevancias: el tiempo es oro, inviértelo en acciones que realmente sumen. Si mañana viene alguien prometiéndote “posicionar #1 en dos días usando la etiqueta X escondida”, ya sabes que suena a cuento chino. Mejor céntrate en hacer un sitio web fantástico que Google quiera mostrar.

Tercero, la evolución es constante. Lo que hoy es verdad, en dos años podría no serlo (aunque los principios básicos llevan mucho sin cambiar, la forma de implementarlos sí). Por ejemplo, el auge de la búsqueda por voz, la inteligencia artificial generando resultados (ChatGPT y compañía influyen en cómo la gente busca), las Core Web Vitals que hace poco se incorporaron… El SEO de aquí a 2025 y más allá seguirá adaptándose. Quizá veamos nuevos factores aparecer (¿experiencia de usuario medida de otra forma? ¿alguna métrica de engagement?), o factores actuales perder peso. Un buen profesional SEO nunca deja de aprender. Hay que estar con el radar encendido para detectar cambios de algoritmo, pruebas que hace Google, nuevas mejores prácticas. Recuerdo cuando apareció la navegación móvil: quien no adaptó su web sufrió. O cuando la velocidad empezó a importar: hubo que optimizar. Cada cambio de estos fue una oportunidad para los que se adelantaron y un castigo para los que ignoraron las tendencias.

En mi caso, tras casi 20 años, una cosa tengo clara: la esencia del SEO perdura, pero los detalles evolucionan. Por eso me gusta esta profesión; te obliga a mantenerte al día, a ser curioso, a experimentar. Y es gratificante, porque ves cómo sitios web mejoran y negocios crecen gracias a aplicar bien estas prácticas.

Para cerrar, te diré que ningún checklist está escrito en piedra. Esta tier list que te he compartido es fruto de mi experiencia personal y criterio a fecha de 2025. Continuamente surgen debates en la comunidad SEO sobre si tal factor debería estar más arriba o abajo. ¡Y está bien! Lo importante es el razonamiento detrás. Yo he querido darte esa perspectiva de por qué considero cada cosa en su nivel. Espero que te ayude a tomar decisiones más informadas.

Mantente actualizado, lee, prueba por tu cuenta (no hay maestro como el ensayo y error controlado), y sobre todo piensa siempre en tu usuario final. Si logras el equilibrio entre optimizar para Google y a la vez para personas, vas por el buen camino. Como me gusta decir: “Haz SEO como si Google no existiera: creando el mejor sitio posible. Pero sabiendo que Google sí existe: facilitándole que reconozca lo bueno que es tu sitio.” Esa es la filosofía ganadora.

Y si lo has logrado, ¡gracias por llegar hasta aquí! Ahora, manos a la obra: revisa tu estrategia según esta tier list y ajusta donde haga falta. Verás que enfocándote en lo que importa de verdad, los resultados llegan. Y los mitos… que se queden en los cuentos alrededor de una hoguera, no en tu plan de acción. ¡Mucho éxito posicionando tu web en 2025! 💪🚀

Por cierto, aquí te dejo cómo quedaría más o menos el Tier List SEO para este 2025: